一、为什么传统编程评测正在失效?

如果你关注大模型编程能力,一定熟悉 HumanEval、MBPP 这类基准测试。它们的标准流程是:给定函数签名和单元测试,模型补全代码片段,最后验证通过率。

这类评测存在根本性局限:它考察的是”算法题解题能力”,而非”工程交付能力”。真实场景中的 UI 生成、依赖管理、交互设计、代码架构——这些占开发者 80% 工作量的技能,在传统基准中几乎为零 。

更关键的是,评测方式与使用方式脱节。HumanEval 是自动评分,但开发者选模型时,更关心”这个模型能不能帮我做出好看的登录页”或”能不能一次性搞定带状态管理的 React 组件”。

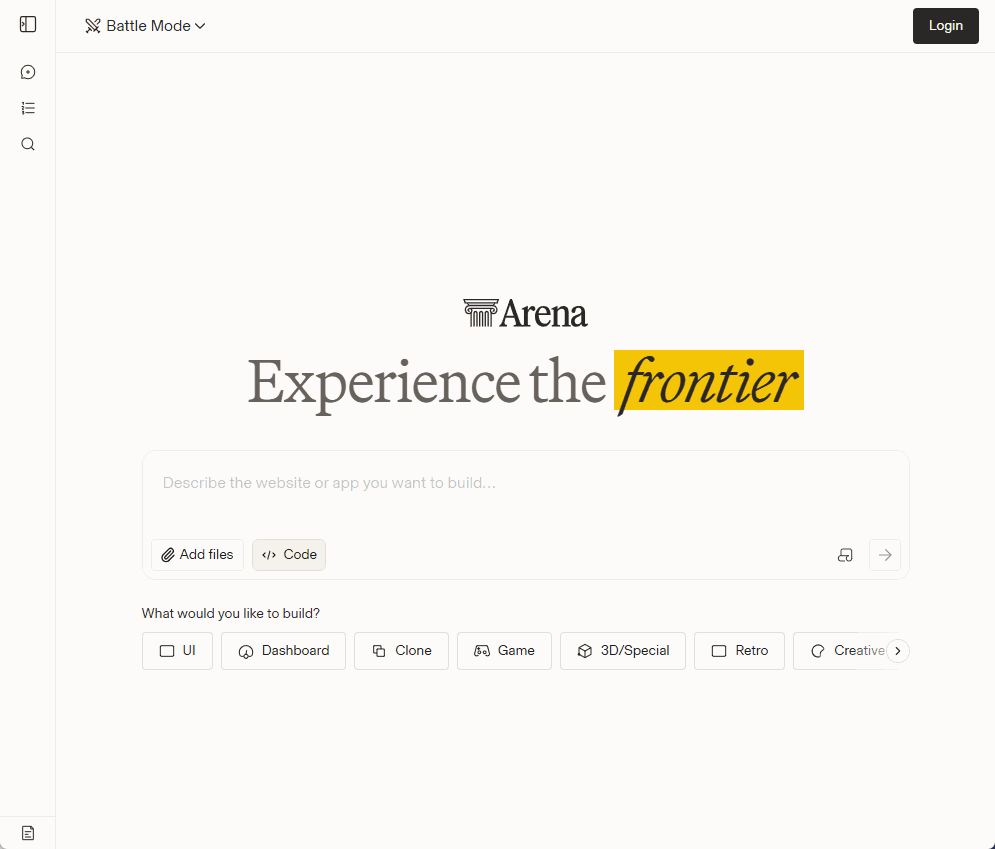

二、WebDev Arena 是什么?

WebDev Arena 是由

LMArena(加州大学伯克利分校 Sky Lab 团队,Chatbot Arena 的开发者)推出的实时

AI 编程竞技平台。其核心机制极其简洁:

-

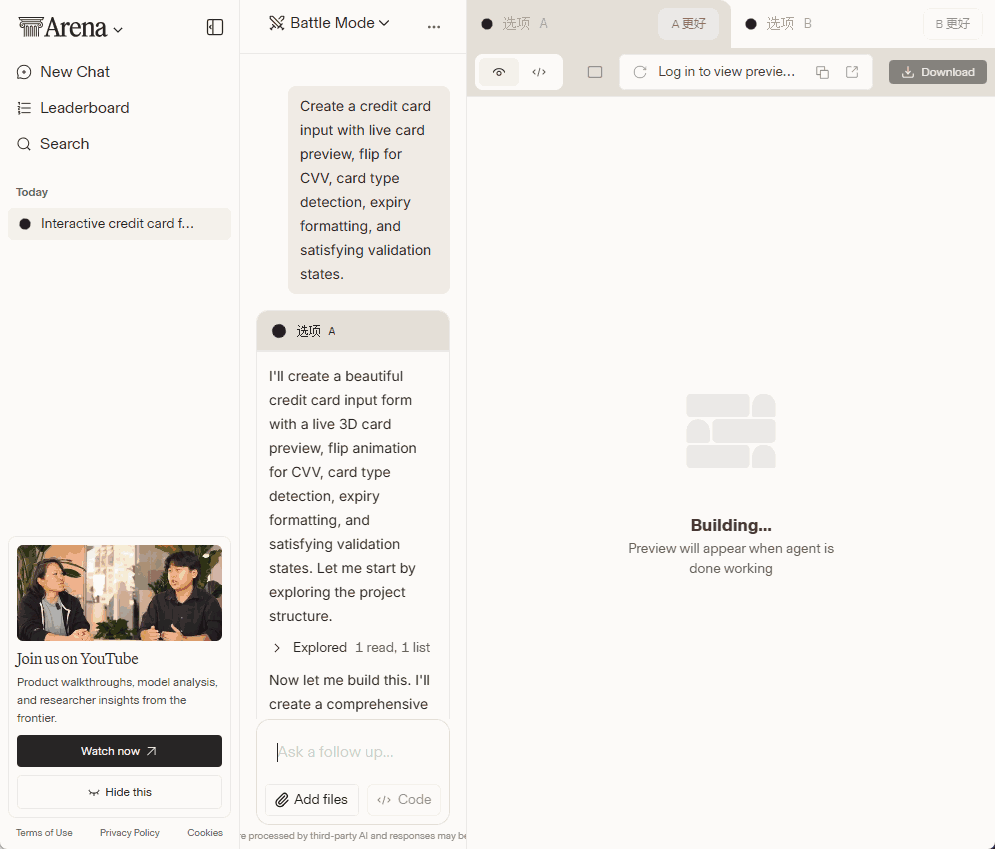

用户输入 prompt(如”创建一个 Hackernews 克隆”或”开发一个可交互的象棋游戏”)

-

两个 LLM 同时生成完整的 Web 应用(HTML/CSS/JS)

-

左右分屏展示,用户可直接操作、点击、测试功能

-

盲测投票,选择功能更完整、交互更流畅、视觉更美观的方案

-

揭晓模型身份,投票结果计入实时排行榜

整个过程在 10-30 秒内完成,用户无需配置环境,浏览器即是沙箱。

三、从”能跑”到”好用”:评测维度的质变

WebDev Arena 的评分标准直接对应真实开发者的决策因素:

-

功能性:应用是否完整实现了需求?计算器能否运算?登录页能否提交?

-

美观度:UI 是否现代、配色是否协调、布局是否响应式?

-

交互体验:按钮是否有反馈?动画是否流畅?错误处理是否优雅?

-

代码质量:结构是否清晰?是否使用了合理的框架模式?

这与传统评测只看”测试用例通过率”形成鲜明对比。正如官方所言:”我们不只检查代码是否能编译,而是评估代码如何思考、规划和构建——在镜像真实开发的条件下。”

四、排行榜背后的技术博弈

WebDev Arena 的 leaderboard 已成为各大模型厂商的前线战场。关键节点包括:

-

Claude 3.7 Sonnet 曾以 76% 平均胜率 登顶,展现 Anthropic 在前端代码生成上的深厚积累

-

DeepSeek-R1 作为开源模型,一度冲入前三,证明推理能力对复杂 UI 任务的价值

-

Gemini 2.5 Pro 在 2025 年 5 月以 +147 Elo 跃升登顶,Google 专门优化了端到端前端生成和高保真渲染

这些波动不仅反映模型迭代,更揭示了

评估标准本身的进化:从”代码能跑”到”代码好看且好用”,再到”能自主规划多文件项目”(Code Arena 已引入 React 多文件评估)。

五、技术实现:如何做到”秒级生成+即时渲染”?

WebDev Arena 的技术架构值得细究:

沙箱安全:所有代码在隔离的浏览器环境中运行,防止恶意脚本

结构化输出:支持 enforced structured output 的模型需遵循特定 JSON schema,包含 commentary(实现思路)、dependencies(依赖列表)、code(实际代码)等字段;不支持的模型则通过 GPT-4.1-mini 转换格式

实时渲染:生成代码直接在浏览器中运行,用户可即时交互

版本追溯:2025 年 11 月升级的 Code Arena 引入持久化会话,完整记录从 prompt 到最终渲染的每一步操作,确保可复现、可审计

这种设计让 WebDev Arena 不仅是评测工具,更成为观察模型”思维过程”的显微镜。

六、对开发者的实际价值

对于

前端工程师,WebDev Arena 提供了独特的

选型参考:

-

横向对比:同一需求下,Claude 和 GPT 谁的布局更合理?谁的交互更完整?

-

Prompt 工程研究:平台收录的数万条任务描述,是研究”如何向 AI 描述需求”的宝贵语料

-

零成本原型验证:在投入生产前,快速测试多个模型对同一复杂需求的理解差异

更重要的是,它揭示了当前 AI 编程的边界:模型能很好地生成静态页面,但在复杂状态管理、跨组件通信、精细化视觉调整上仍有明显短板——这些正是人类开发者的护城河。

七、局限与反思

WebDev Arena 并非完美。目前的挑战包括:

-

任务偏差:用户提交的多为前端界面类需求,对后端逻辑、数据库设计、系统架构覆盖不足

-

审美主观性:”美观度”评分受个人偏好影响,难以标准化

-

长程依赖:复杂应用的多文件架构、调试能力尚未被充分测试(Code Arena 正通过 React 多文件项目解决此问题)

但这些局限恰恰指明了方向:AI 编程评测的终局,不是取代人类判断,而是构建更透明、可解释、可复现的评估基础设施。

结语

WebDev Arena 的价值,在于它首次让大模型的编程能力可交互、可比较、可进化。当 DeepSeek-R1 与 Claude Opus 在排行榜上并驾齐驱时,我们看到的不只是分数,更是开源与闭源、算法优化与工程落地之间的激烈碰撞。